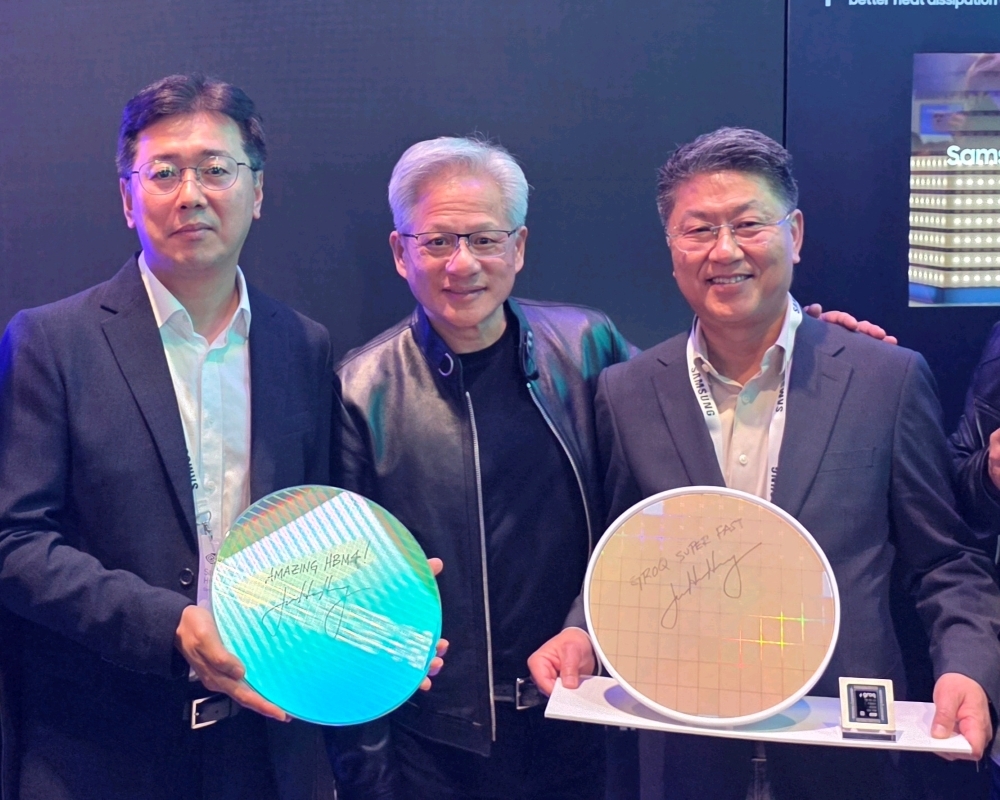

Während der AGB 2026Samsung hat den Start der Massenproduktion seines HBM4-Speichers formalisiert für die Vera Rubin-Plattform von Nvidia bei der Vorstellung seines HBM4E-Speichers zum ersten Mal neue Generation.

Letzterer verspricht 16 Gbit/s pro Pin und eine Bandbreite von 4,0 TB/s. Es muss eine strategische Allianz konsolidieren, die nun die gesamte KI-Wertschöpfungskette abdeckt.

Wie hoch ist die Leistung der neuen HBM4- und HBM4E-Speicher von Samsung?

Der HBM4-Speicher der sechsten Generation, der sich bereits in Massenproduktion befindet, liefert stabile Verarbeitungsgeschwindigkeiten von 11,7 Gigabit pro Sekunde (Gbit/s) pro Pin, mehr als die 8 Gbit/s der Komponenten der vorherigen Generation.

Noch beeindruckender ist, dass Samsung seinen HBM4E vorgestellt hat mit einem Prototyp, der 16 Gbit/s pro Pin erreicht und eine Gesamtbandbreite von 4,0 Terabyte pro Sekunde (TB/s) pro Stapel.

Diese Leistung ist entscheidend, um zukünftige KI-Beschleuniger ohne Engpässe zu versorgen. Um dieses Niveau zu erreichen, hat Samsung nutzt seinen 10-Nanometer-(1c)-Klasse-DRAM-Prozess und neue Montagetechnologie.

Das Unternehmen stellte seinen Prozess vor Hybrid-Kupfer-Bonding (HCB), eine Kupferverbindungsmethode, die das Stapeln von 16 oder mehr Speicherschichten ermöglicht. Diese Technik reduziert den Wärmewiderstand um mehr als 20 % im Vergleich zu herkömmlichen Methoden, ein Detail, das alles für das Energiemanagement von Rechenzentren verändert.

Wie festigt diese Ankündigung die Allianz zwischen Samsung und Nvidia?

Diese Ankündigung verwandelt eine einfache Kunden-Lieferanten-Beziehung in eine tiefe strategische Partnerschaft. HBM4-Speicher wurde speziell für die zukünftige NVIDIA Vera Rubin-Plattform entwickelt während der HBM4E bereits auf die nächste Generation, Rubin Ultra, abzielt.

Samsung widmete an seinem Stand sogar ein „NVIDIA-Galerie“ um gemeinsam entwickelte Lösungen wie das SOCAMM2-Speichermodul freizulegen und die SSD PM1763, die Schlüsselelemente der Referenzarchitektur von Nvidia sind.

Mit dem AI-Factory-Projekt geht Nesting noch weiter. Samsung plant, Nvidia-Technologien, einschließlich der Omniverse-Plattform, zu implementieren, um digitale Zwillinge zu erstellen eigener Halbleiterfabriken.

Mit anderen Worten: Nvidias KI wird die Herstellung von Speicherchips optimieren, die künftige Nvidia-GPUs ausstatten werden. Es ist ein positiver Kreislauf, in dem Nvidia die Fabriken optimiert, die seine eigenen Komponenten herstellenwas beiden Unternehmen einen kaum aufzuholenden Technologievorsprung beschert.

Welche weiteren Innovationen hat Samsung neben dem HBM-Speicher noch vorgestellt?

Samsung hat seinen Wunsch unter Beweis gestellt, alle Segmente des KI-Marktes abzudecken, vom Rechenzentrum bis hin zu persönlichen Geräten. Der Riese stellte seine SSD PM1763 ausbasierend auf der hochmodernen PCIe 6.0-Schnittstelleder ultraschnelle Datenübertragungen für Speicherlösungen der nächsten Generation ermöglicht.

Für „lokale“ KI (auf dem Gerät, eingebettet in Terminals) präsentierte das Unternehmen NAND-Lösungen wie PM9E3 und PM9E1 für persönliche Supercomputer wie den NVIDIA DGX Spark.

Auf der mobilen Seite die Chips LPDDR5X und LPDDR6 wurden vorgebracht. Insbesondere LPDDR6 erhöht die Bandbreite auf bis zu 35 Gbit/s pro Pin und integriert gleichzeitig erweiterte Energieverwaltungsfunktionen.

Diese Komponenten sind unerlässlich, um anspruchsvolle KI-Anwendungen auf Smartphones und Tablets auszuführen, ohne dass der Akku im Handumdrehen entladen wird.

Welche Strategie verfolgt Samsung hinter dieser Machtdemonstration?

Die Strategie besteht darin, die einzigartige IDM-Struktur (Integrated Device Manufacturer) zu nutzen, um die einzige Komplettlösung für KI zu werden.

Während sich Konkurrenten wie SK Hynix vor allem auf den Speicher konzentrieren, setzt Samsung unterstreicht seine Fähigkeit, die gesamte Kette zu kontrollieren: Speicher, Logik, Gießerei und fortschrittliche Verpackung.

Diese vertikale Integration ermöglicht die Co-Optimierung jeder Komponente, um komplette Subsysteme zu erstellen, anstatt Ersatzteile zu verkaufen.

In einem KI-Infrastrukturmarkt, der voraussichtlich 200 Milliarden US-Dollar pro Jahr erreichen wird Bis 2027 ist der Abschluss von Verträgen mit Nvidia, das mehr als 90 % des Marktes für Laufwerkschips kontrolliert, ein Garant für massives Wachstum.

Indem Samsung sich nicht mehr als Lieferant, sondern als wesentlicher Partner des Nvidia-Ökosystems positioniert, unterstreicht Samsung die Gewährleistung von Leistung und Verfügbarkeit.

Die Ankündigung ist eine Absichtserklärung, aber der eigentliche Kampf wird um die Fähigkeit ausgetragen, die Produktionsraten aufrechtzuerhalten höllische Bedingungen, die der Markt verlangt.