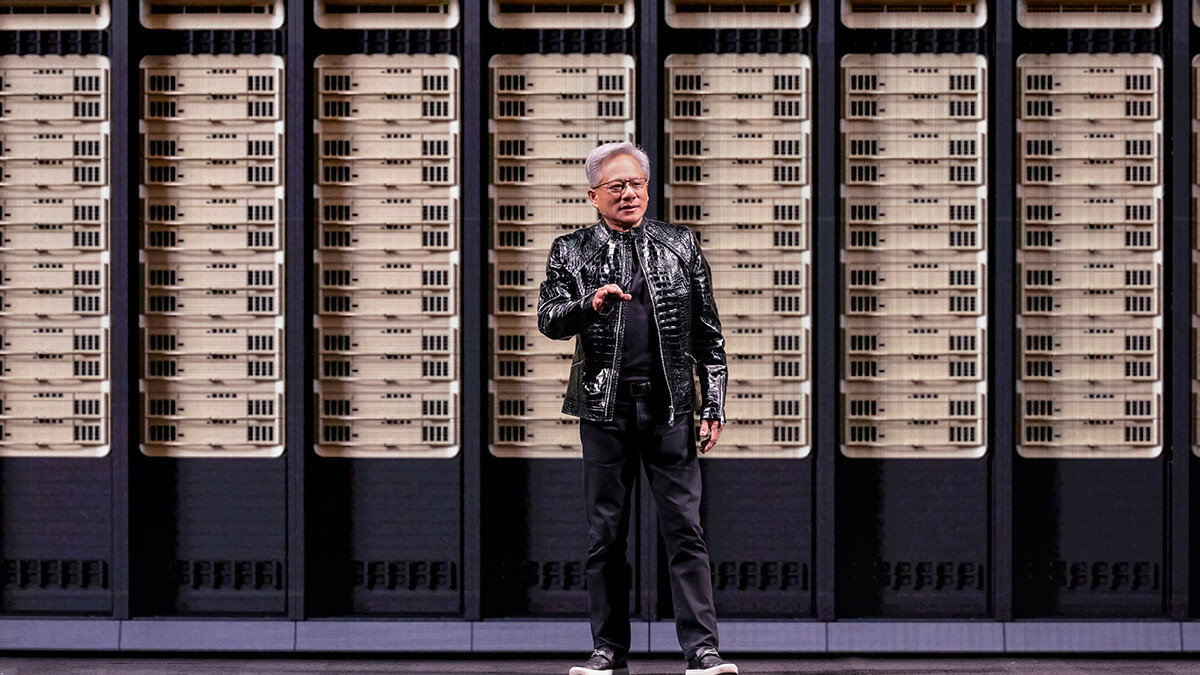

Während seiner jährlichen GTC 2026-Veranstaltung präsentierte der Halbleiterriese Nvidia durch seinen CEO Jensen Huangpräsentierte seine Roadmap zur Eroberung dessen, was er „ die letzte Grenze »: räumliches Rechnen.

Nvidia hat auf seiner GTC 2026-Konferenz seine neue, für den Weltraum konzipierte Computerplattform formalisiert. Das „Vera Rubin Space Module“-System » zielt darauf ab, zukünftige Orbital-Rechenzentren auszustatten und intelligente Satelliten.

Diese Initiative ermöglicht die Verarbeitung von Daten direkt im Orbit und ebnet den Weg für eine neue Ära der Autonomie und Echtzeitanalyse für Weltraummissionen.

Was ist diese neue Nvidia-Plattform für den Weltraum?

Die Hardwareplattform des Vera Rubin Space Module ist so konzipiert, dass es den extremen Platzverhältnissen standhält, insbesondere in Bezug auf Größe, Gewicht und Stromverbrauch (SWaP). Für Größe, Gewicht und Leistung).

Laut Nvidia würde dieses Modul bis zu 25-mal mehr Rechenkapazität für Inferenz bieten (die Verwendung eines trainierten KI-Modells). dem des bereits sehr leistungsstarken H100. Das ist ein kolossales Leistungsversprechen für räumliche künstliche Intelligenz.

Diese Plattform basiert auf einer eng integrierten CPU-GPU-Architektur, abgeleitet von der neuen terrestrischen Produktreihe namens Vera Rubin. Es wird durch weitere Lösungen wie Jetson Orin-Module ergänzt für weniger intensive Aufgaben und IGX Thor.

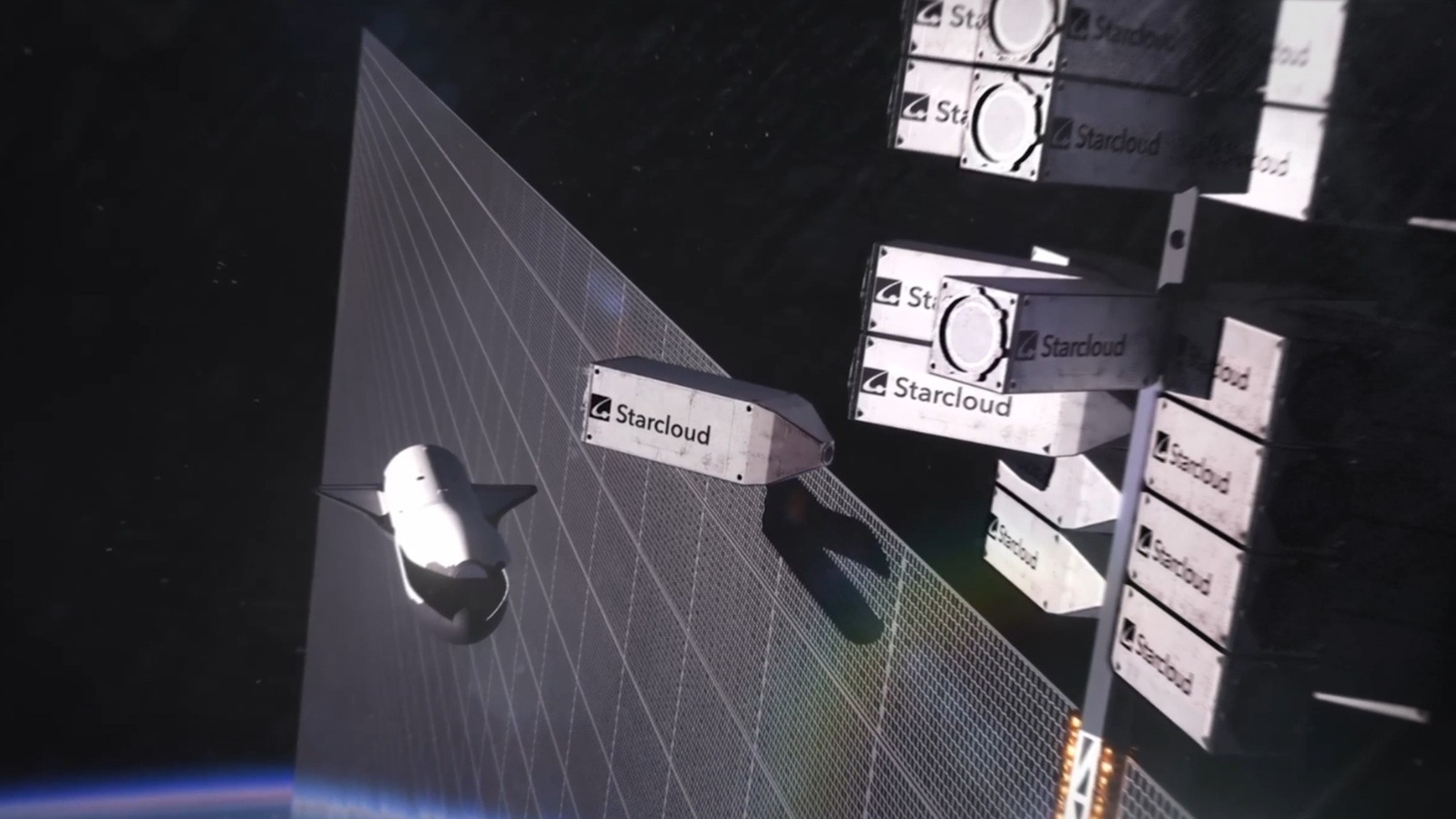

Partner wie Axiom Space, Starcloud und Planet Labs sind bereits im Rennen um die Integration dieser Technologien. Die Initiative für Weltraumdatenzentren ist bereits im Gange und die ersten konkreten Anwendungen werden bald keine Science-Fiction mehr sein.

Warum Rechenzentren in die Umlaufbahn schicken?

Die Idee mag extravagant erscheinen, reagiert aber auf ganz konkrete Herausforderungen. Erstellen Sie orbitale Rechenzentren würde zwei große Probleme auf der Erde umgehen: den Stromverbrauch und Kühlung.

Im Weltraum ist Solarenergie praktisch unbegrenzt und kostenlos. Obwohl die Kühlung aufgrund der fehlenden Konvektion technisch komplex ist, stellt sie eher eine technische Herausforderung als eine energetische Sackgasse dar.

Jensen Huang selbst gab zu, dass die Wärmeübertragung durch Strahlung eine echte thermische Herausforderung darstellt zu lösen. Der andere große Vorteil ist die Nähe zur Datenquelle.

Beobachtungs-, Kommunikations- und Spionagesatelliten erzeugen täglich Terabytes an Daten. Die Verarbeitung vor Ort ermöglicht Entscheidungen in Echtzeit, die für die autonome Navigation von Sonden oder die sofortige Analyse von Geodaten von entscheidender Bedeutung sind.

Dies ist das Ende des Engpasses, den die Abwärtsverbindung zur Erde darstellt, und eröffnet den Weg zu einer beispiellosen Entscheidungsautonomie für Maschinen im Orbit.

Was sind die Herausforderungen und Konkurrenten in diesem Wettlauf um räumliche KI?

Nvidia ist nicht der Einzige, der die Sterne im Auge hat. Der Wettbewerb ist bereits hart und verwandelt die niedrige Umlaufbahn in ein neues technologisches Schlachtfeld. Google mit seinem Projekt Suncatcheruntersucht ähnliche Konzepte.

Aber der größte Konkurrent ist zweifellos das Duo SpaceX und xAIkürzlich in einer Titanic-Operation fusioniert. Elon Musk macht keinen Hehl aus seinem Ehrgeiz, eine Megakonstellation von einer Million Satelliten zu stationieren der KI gewidmet. Diese Satellitenkonstellationen werfen jedoch erhebliche Umweltbedenken auf.

Die Hindernisse sind zahlreich. Obwohl die Kosten für Starts sinken, bleiben sie ein großes Hindernis. Darüber hinaus beunruhigen die Risiken im Zusammenhang mit Trümmern in der Umlaufbahn und Lichtverschmutzung die wissenschaftliche Gemeinschaft.

Es wird auch notwendig sein, Nvidia-Chips zu entwerfen und andere Komponenten, die kosmischer Strahlung widerstehen können jahrelang. Dies ist ein Langstreckenrennen, bei dem Zuverlässigkeit genauso wichtig ist wie pure Leistung. Die Erforschung der letzten Grenze hat gerade erst begonnen.